muri23

L13: Maniac

Voll spielbar also...geradeaus laufen autoclimb, autojump und der Taschenlampentrick...wowNun war die Epic Demo laut denen voll spielbar und das sah auch danach aus

Das kann man vom Hellblade Material nun nicht behaupten

Im folgenden Video siehst du, wie du consolewars als Web-App auf dem Startbildschirm deines Smartphones installieren kannst.

Hinweis: This feature may not be available in some browsers.

Voll spielbar also...geradeaus laufen autoclimb, autojump und der Taschenlampentrick...wowNun war die Epic Demo laut denen voll spielbar und das sah auch danach aus

Das kann man vom Hellblade Material nun nicht behaupten

Vielleicht weil's reale Spiele waren, dazu noch von Indies und keine Demo?

Die 2,23 GHz liegen in der Spezifikation von RDNA 2.Das heben die sich eventuell für Später auf.

Was die Gleichheit der GPUs angeht noch eins. Der höhere Takt der PS5 muss zu einer anderen Anordnung der Halbleiter führen. Die Taktfrequenz ist im Mikrowellen Bereich. Da braucht man schon eine andere Abschirmung ( Masselayer ) und eventuell sogar breitere Lanes, um den Widerstand zu verringern. Das kostet DIE Fläche.

Wären die GPUs komplett gleich, wäre Microsoft ja schön blöd nicht auch höher zu Takten.

Angeblich funktioniert Lumen komplett ohne Ray Tracing.

Kann mir jemand erklären wie das funktionieren soll? Und wieso sollte man auf Raytracing setzen, wenn Lumen und dieses Pixel-Polygon Feature so gute Ergebnisse liefert, und dennoch deutlich ressourcenschonender laufen soll als Ray Tracing?!?

und das ganze ohne Hardware Beschleunigung a la RTX....

Voll spielbar also...geradeaus laufen autoclimb, autojump und der Taschenlampentrick...wow

Scheint was anderes zu sein, virtual geometry images (Vorsicht Triggerwarnung: Paper von MS Research). Im Prinzip geht es darum, Geometrie in eine regelmäßige Oberfläche (== Bild) umzukodieren. Und Virtualisierung und Streaming von Bildern ist ein besser verstandenes Problem. Hier hat der Verantwortliche bei Epic einen Blogpost dazu geschrieben:Ist das nicht eine Fuktion der Meshshader?

Hier wird doch fast die normale Renderpipeline komplett umgestellt und sorgt doch gerade dafür, Millionen von Polys pro Frame aus Milliarden davon darstellen zu können.

Mein Widerspruch bezog sich auf "Der Polycount war übertrieben hoch.". Epic sagt eben, es gibt kein übertrieben hoch mehr. Gut, wir wissen nicht wie groß die Demo insgesamt auf der SSD ist, in dem Ram gestreamt funktioniert es aber immerhin auf der PS5.Auf was bezieht sich das Nein überhaupt, wenn du mir nicht widersprichst? Alles was ich sage ist, dass diese Demo gemacht wurde um die Engine zu vermarkten. Vermarkten = Marketing. „Marketing-Spruch“ hast du mir in den Mund gelegt. Aber wenn man sich dann jetzt über Frameraten beschwert, ist das dann auch ein Problem der Engine, nicht der Plattform. Ansonsten: ja, hast recht.

Weil sie eben keine idioten sind und von alleine wissen das mit takt erhöhung abwärme und verbrauch steigt und das so rapide ab einem gewissen punkt, das wohl schon 20% takt Erhöhung zu einer doppelt so großen Box geführt hättenNa dann ruf mal schnell bei Microsoft an. 15Tflops sind da minimum drin. Das die Idioten da nicht von selbst drauf gekommen sind....

Angeblich funktioniert Lumen komplett ohne Ray Tracing.

Kann mir jemand erklären wie das funktionieren soll? Und wieso sollte man auf Raytracing setzen, wenn Lumen und dieses Pixel-Polygon Feature so gute Ergebnisse liefert, und dennoch deutlich ressourcenschonender laufen soll als Ray Tracing?!?

und das ganze ohne Hardware Beschleunigung a la RTX....

Mein Widerspruch bezog sich auf "Der Polycount war übertrieben hoch.". Epic sagt eben, es gibt kein übertrieben hoch mehr. Gut, wir wissen nicht wie groß die Demo insgesamt auf der SSD ist, in dem Ram gestreamt funktioniert es aber immerhin auf der PS5.

Die 2,23 GHz liegen in der Spezifikation von RDNA 2.

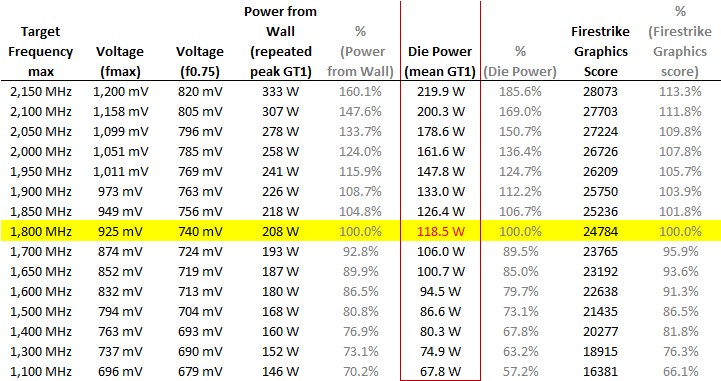

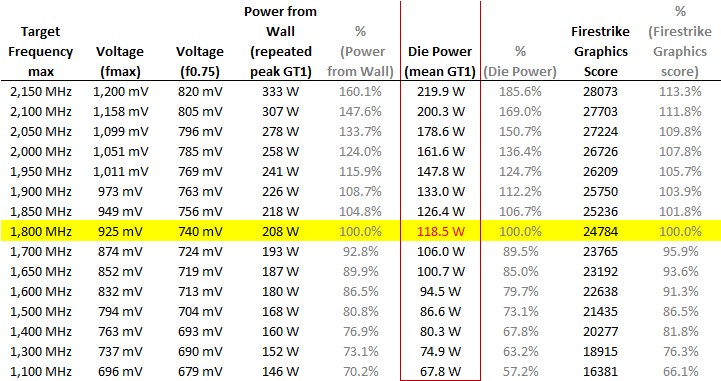

MS fährt keinen Höheren Takt, weil das bei 52 CUs viel zu viel Abwärme erzeugen würde. Dank des enorm hohen Taktes wird die GPU der PS5 mit 10 TF schon mehr Leistung aufnehmen, als die 12 TF der XSX (etwa 3%).

Eine Takterhöhung von 1,8 GHz auf 2,2 GHz würde ein Abwärmeplus von etwa 50% bedeuten.

Deshalb war die GPU der PS5 wohl auch Anfangs mit 2GHz spezifiziert.

Wir wissen ja nicht, was die Performance kostet und wie das alles im Detail funktioniert. Ist es die Geometrieverarbeitung? Wenn ich die Paper richtig verstanden habe, sollte das eher besser funktionieren als bisher. Oder ist es die Lichtberechnung? Wenn das wie bei NVidia und deren GI funktioniert, dann dürfte eine Beschleunigung durch Hardware-RT da z.B. noch einiges bringen.Achso. Ja, verstehe. Wobei sich mir noch nicht so ganz erschließt, wie das funktioniert. an irgendeiner Stelle muss Zuviel doch auch Zuviel sein. Und für mein Verständnis haben sie dahingehend halt geklotzt und nicht auf Framerate optimiert. Deshalb find ich die Frameratendiskussion halt irgendwie seltsam.

Na komm, du bist ja lange genug hier um es eigentlich besser zu wissen, oder?Plattform CW. 2 Jahre raus, keine Veränderung. Schade eigentlich.

www.4players.de

www.4players.de

Wir wissen ja nicht, was die Performance kostet und wie das alles im Detail funktioniert. Ist es die Geometrieverarbeitung? Wenn ich die Paper richtig verstanden habe, sollte das eher besser funktionieren als bisher. Oder ist es die Lichtberechnung? Wenn das wie bei NVidia und deren GI funktioniert, dann dürfte eine Beschleunigung durch Hardware-RT da z.B. noch einiges bringen.

Na komm, du bist ja lange genug hier um es eigentlich besser zu wissen, oder?

Siehe den Post von @Con$olef@natic .Trotzdem wird auf Grund des höheren Taktes eine andere Architektur benötigt. Sony sagt, was sie brauchen und AMD liefert. Dank der AK war eben die Architektur mit den 36CUs bei höherem Takt sinnvoll. Microsoft ist da auf Grund ihrer Vorgänger Konsole im Vorteil.

Auf dem Wafer zählt jeder Substrat oder älter ausgedrückt P/N Übergang. Mit einem niedrigen Takt hat man, wie schon richtig angemerkt weniger Hitzeentwicklung. Mit zunehmender Frequenz kommen dann Probleme wie Induktivität und Kapazität unter den Lanes. Dies alles gilt es zu berücksichtigen und man muss anders dotieren.

Weil sie eben keine idioten sind und von alleine wissen das mit takt erhöhung abwärme und verbrauch steigt und das so rapide ab einem gewissen punkt, das wohl schon 20% takt Erhöhung zu einer doppelt so großen Box geführt hätten

Nicht umsonst wird vermutet das die PS5 sogar mehr verbrauchen wird als die XsX

Und da es mir spaß macht dich immer wieder auf zu klären, hier mal der verbrauch von Navi wenn man über die ~1.8Ghz sweetspot geht.

Beim takt der PS5 hast du dann ~100% mehr verbrauch und wohl abwärme

RDNA2 soll das laut AMD aber verbessern.

Und man sieht auch gut wie wenig man an Mhz runter muss bei "nur" 2.15GHz um 10% zu sparen die Cerny ansprach, das wird bei 2.23Ghz noch weniger

Du solltest Physik 2 und Grundlagen Elektronik nochmal belegen.Erst erzählst Du was vom Problemlosen Übertakten deiner PC Grafikkarte und dann kommst Du mit dem Sweetspot um die Ecke. Was hat das mit Aufklärung zu tun, außer das Du deinen eigenen Blödsinn widerrufen hast?

Mir hast Du jedenfalls nichts Neues erzählt. Aber immer wieder schön, wie hier mit Halbwissen angegeben wird und man noch versucht Andere runterzuputzen.....