TheProphet

L99: LIMIT BREAKER

- Seit

- 30 Apr 2002

- Beiträge

- 62.610

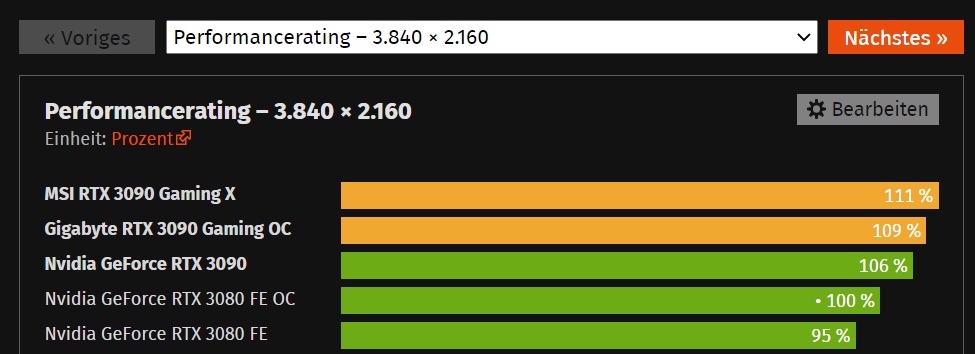

Ganz ohne Zutun gehen diese Karten aber gar nicht auf so hohe Taktraten hoch, was ist das für ein BlödsinnGanz ohne OC oder anderes Zutun des Anwenders steigen diese Karten bei einem Takt von rund 2.010 bis 2.040 MHz aus und sorgen für ein Crash to Desktop (CTD) oder Instabilitäten in Spielen.

Die kommen ohne OC oder Powerlimit Erhöhung gar nicht über 1950MHz hinweg. Dennoch natürlich traurig, dass die Karte über 2.000MHz nicht stabil läuft, könnte aber auch mit dem hitzigen GDDR6X zusammenhängen.

EDIT:

" Ein negatives Offset von mindestens 100 MHz beim GPU-Takt kann vorerst Abhilfe schaffen, auch steht das Windows-10-Feature „Hardware-beschleunigte GPU-Planung“ im Verdacht, die Probleme im aktivierten Zustand zu verstärken. Diese kann unter Windows 10 über „Einstellungen > System > Anzeige > Grafikeinstellungen“ deaktiviert werden. "

Naja gut, das kann natürlich sein, aber, dass Windows da die Taktraten der GPU überschreibt ist schon etwas überraschend

Zuletzt bearbeitet:

warum sollte auch

warum sollte auch

wo warst dui da als sie gepostet wurden? hättest doch eigentlich einspruch einlegen müssen das sie niemals 60fps schaffen können mit DLSS

wo warst dui da als sie gepostet wurden? hättest doch eigentlich einspruch einlegen müssen das sie niemals 60fps schaffen können mit DLSS