Upps Artikel wurde schon korrigiert, Crysis hat Raytracing Effekte schon seit Jahren

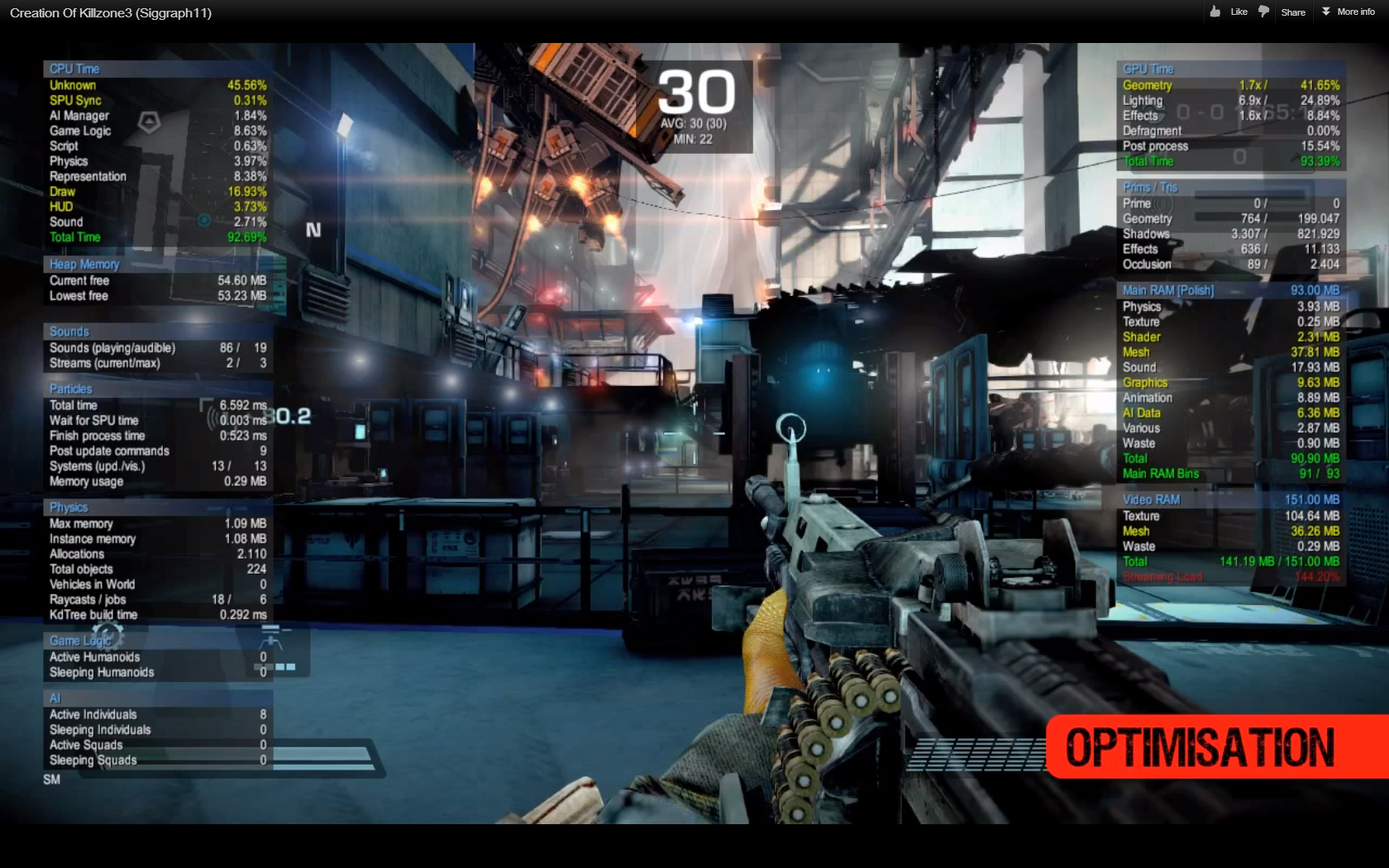

Schon Killzone 2 nutzte Raytracing für einige spezielle Lichteffekte.

Im folgenden Video siehst du, wie du consolewars als Web-App auf dem Startbildschirm deines Smartphones installieren kannst.

Hinweis: This feature may not be available in some browsers.

Upps Artikel wurde schon korrigiert, Crysis hat Raytracing Effekte schon seit Jahren

Meinst du ray casts für AI, Kollisionsabfragen u.ä.? Das hat recht wenig mit Raytracing zu tun, genauso wenig wie das hier beschriebene Verfahren, das im screen space arbeitet.Raytracing wird schon lange für viele dinge in games verwendet

Nene, da wird schon "echtes" Raytracing verwendet (halt einfach im Screenspace), wird z.B. auch schon länger für die Darstellung von Augen eingesetzt.. Allerdings ist es nicht so, dass die gesamte Szene via Raytracing dargestellt wird, falls Du das meintest.Meinst du ray casts für AI, Kollisionsabfragen u.ä.? Das hat recht wenig mit Raytracing zu tun, genauso wenig wie das hier beschriebene Verfahren, das im screen space arbeitet.

Meinst du ray casts für AI, Kollisionsabfragen u.ä.? Das hat recht wenig mit Raytracing zu tun, genauso wenig wie das hier beschriebene Verfahren, das im screen space arbeitet.

Killzone 4 Uses Raytracing For Its Real-Time Reflections

Quelle: http://www.dsogaming.com/news/killzone-4-uses-raytracing-for-its-real-time-reflections/

Am Ende des Videos wenn das Finale Bild gezeigt wird, dann spiegeln sich im Wasser am Boden nichtmal die Charaktere...

Genauso wie im Gameplay Trailer sich in den ganzen Fenstern nur die Umgebung, aber keine beweglichen Objekte, spiegeln.

Was ist also nun so besonders daran?

Am Ende des Videos wenn das Finale Bild gezeigt wird, dann spiegeln sich im Wasser am Boden nichtmal die Charaktere...

Genauso wie im Gameplay Trailer sich in den ganzen Fenstern nur die Umgebung, aber keine beweglichen Objekte, spiegeln.

Was ist also nun so besonders daran?

sie spiegeln sich im gameplaytrailer?Am Ende des Videos wenn das Finale Bild gezeigt wird, dann spiegeln sich im Wasser am Boden nichtmal die Charaktere...

Genauso wie im Gameplay Trailer sich in den ganzen Fenstern nur die Umgebung, aber keine beweglichen Objekte, spiegeln.

Was ist also nun so besonders daran?

Die hatten ein Durcheinander mit den Folien, fand das auch verwirrendAm Ende des Videos wenn das Finale Bild gezeigt wird, dann spiegeln sich im Wasser am Boden nichtmal die Charaktere...

Genauso wie im Gameplay Trailer sich in den ganzen Fenstern nur die Umgebung, aber keine beweglichen Objekte, spiegeln.

Was ist also nun so besonders daran?

In der Tat spiegeln sich bei dem Effekt auch bewegte Objekte. Sieht man auch recht gut im Trailer:

In der Tat spiegeln sich bei dem Effekt auch bewegte Objekte. Sieht man auch recht gut im Trailer:

RayTracing ist unwichtig, ich warte noch 100 jahre dan gehst los

Tim Sweeney: 5000 TFLOPS to reach "reality"

http://gamrconnect.vgchartz.com/thread.php?id=159015

Wiso das? Sollte das mit Raytracing nicht problemlos gehen?sobald man aber steil nach unten schaut müssen sie den Effekt ausblenden, da der (nur in der Reflektion sichtbare Himmel) nicht auf dem Screen bereits sichtbar ist..

Meine das schon so, dass nur für den Reflektionen-Teil ein Ray-wasauchimmer-Renderpass läuft.Nene, da wird schon "echtes" Raytracing verwendet (halt einfach im Screenspace), wird z.B. auch schon länger für die Darstellung von Augen eingesetzt.. Allerdings ist es nicht so, dass die gesamte Szene via Raytracing dargestellt wird, falls Du das meintest.

Naja, dann ist Wolfenstein 3D auch Raytracing. Da würde ich jetzt schon genauer sein. Vernünftiges Lichtmodell, Stochastik/Samples usw. gehören da einfach dazu.Edit: Raytracing ist ja nix anderes als das Verfolgen von (Licht- oder Seh-) Strahlen, von dem her könnte man sogar Raycasts als Raytracing bezeichnen.

So wie ich das verstanden habe, setzen sich die Reflektionen in KZ aus mehreren Teilen zusammen. Der statischen Cubemap, dem Raytracing-Teil im Screenspace und was dynamisches für andere Objekte ausserhalb des Screenbereichs muss auch da sein. Wenn letzteres fehlt, gibt es keinen Helikopter in der Reflektion zu sehen. Kann auch sein das die Cubemap nicht statisch ist wie die anderen Lightmaps, hab die Präsentation nicht komplett gesehen.Am Ende des Videos wenn das Finale Bild gezeigt wird, dann spiegeln sich im Wasser am Boden nichtmal die Charaktere...

Genauso wie im Gameplay Trailer sich in den ganzen Fenstern nur die Umgebung, aber keine beweglichen Objekte, spiegeln.

Denke wird ähnlich sein wie das was crytek in dem Video als realtime local reflections bezeichnet ab 1:07:So wie ich das verstanden habe, setzen sich die Reflektionen in KZ aus mehreren Teilen zusammen. Der statischen Cubemap, dem Raytracing-Teil im Screenspace und was dynamisches für andere Objekte ausserhalb des Screenbereichs muss auch da sein. Wenn letzteres fehlt, gibt es keinen Helikopter in der Reflektion zu sehen. Kann auch sein das die Cubemap nicht statisch ist wie die anderen Lightmaps, hab die Präsentation nicht komplett gesehen.

Die hatten ein Durcheinander mit den Folien, fand das auch verwirrendIn der Tat spiegeln sich bei dem Effekt auch bewegte Objekte.

Wiso das? Sollte das mit Raytracing nicht problemlos gehen?

Wiso das? Sollte das mit Raytracing nicht problemlos gehen?

Meine das schon so, dass nur für den Reflektionen-Teil ein Ray-wasauchimmer-Renderpass läuft.

Naja, dann ist Wolfenstein 3D auch Raytracing. Da würde ich jetzt schon genauer sein. Vernünftiges Lichtmodell, Stochastik/Samples usw. gehören da einfach dazu.

So wie ich das verstanden habe, setzen sich die Reflektionen in KZ aus mehreren Teilen zusammen. Der statischen Cubemap, dem Raytracing-Teil im Screenspace und was dynamisches für andere Objekte ausserhalb des Screenbereichs muss auch da sein. Wenn letzteres fehlt, gibt es keinen Helikopter in der Reflektion zu sehen. Kann auch sein das die Cubemap nicht statisch ist wie die anderen Lightmaps, hab die Präsentation nicht komplett gesehen.

Denke wird ähnlich sein wie das was crytek in dem Video als realtime local reflections bezeichnet ab 1:07: